一句话生成 3D 模型,英伟达也来 " 秀肌肉 " 了~

来看它最新捣鼓出的Magic3D AI,效果是这样儿的。

输入 " 坐在睡莲上的蓝色箭毒蛙 ",就能得到这样一个细节丰富的 3D 模型:

不知道这把有没有打到你的心巴上?

反正建模师看了都要喊失业了……

如何做到?

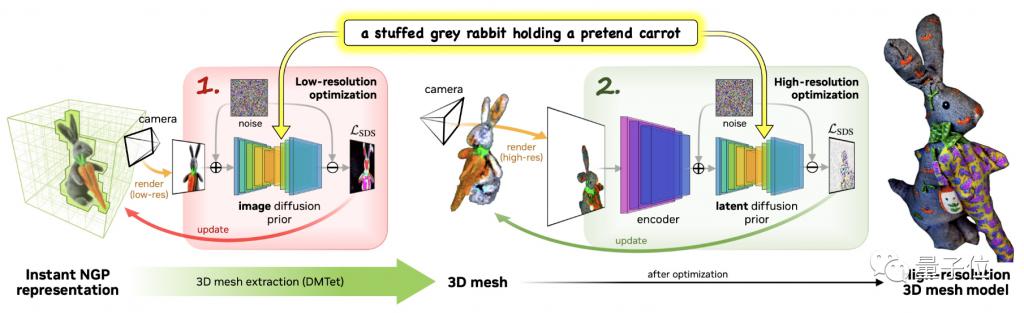

据介绍,Magic3D 快速、高质量地得到结果所采用的策略是 " 从粗到细 ",一共经过两阶段:

低分辨率优化和高分辨率优化。

它使用eDiff-l作为模型的低分辨率文本到图像扩散先验(diffusion prior)。

首先,第一阶段,采用英伟达今年推出的 3D 重建模型Instant NGP,并对其优化,生成初始 3D 模型。

具体来说,就是通过重复采样和渲染低分辨率图像,计算出 SDS 损失,让 Instant NGP 给出结果。

注:SDS 全称得分蒸馏采样(Score Distillation Sampling),是谷歌提出的一种新的采样方法,它无需对扩散模型进行反向传播更新。

这步完成后,就使用 DMTet 提取出初始 3D mesh,作为第二阶段的输入。

第二阶段采用高分辨率文本到图像潜(latent)扩散先验。

还是使用同样的方法,对高分辨率图像进行采样和渲染,并使用相同的步骤进行更新,得到最终结果。

唯一的不同,就是本阶段的操作都是在第一阶段得出的初始 " 糙 " 模型上进行的。

比 DreamFusion 分辨率高 8 倍,速度快 2 倍

关注这一领域的朋友知道,一句话生成 3D 模型的 AI 中,目前最受关注的当属谷歌今年 9 月刚发布的 DreamFusion。

不过,遗憾的是,Magic3D 还并未像 DreamFusion 一样已开源。

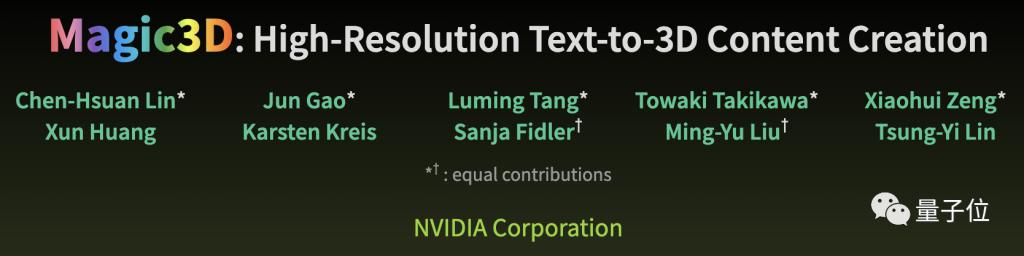

关于作者

一共有 10 位。

前 5 位都具有同等贡献,包括:

现英伟达研究科学家、博士毕业于 CMU 机器人专业的 Lin Chen-Hsuan,他曾在 Facebook 人工智能研究部和 Adobe 实习;

正在多伦多大学读博士的 Gao Jun,北大计算机本科毕业;

正在多伦多读博士的 Zeng Xiaohui,香港科技大学毕业;

以及同样来自该大学的 Towaki Takikawa;

最后是正在康奈尔大学读博士的唐路明,清华大学物理和数学专业本科毕业。

论文地址:

https://arxiv.org/abs/2211.10440

项目主页:

https://deepimagination.cc/Magic3D/

参考链接:

https://twitter.com/_akhaliq/status/1594505474774278147?s=46&t=Dc0f1ExmRsdk_PHz2JX-IA

还没有评论,来说两句吧...